Энтузиаст выложил на GitHub проект Z80-μLM. Это языковая модель весом всего 40 килобайт. Она запускается на 8-битном процессоре Z80 из 1970-х годов.

Z80-μLM использует 2-битное квантование. Модель работает на процессоре Z80 с 64 КБ оперативной памяти. Вся система помещается в один файл формата .COM размером 40 КБ. Туда входит вывод, веса и интерфейс чата.

Автор пошел на радикальные компромиссы из-за жестких ограничений. Применил хеширование триграмм. Метод устойчив к опечаткам, но нарушает порядок слов. Использовал 16-битную целочисленную математику вместо операций с плавающей точкой.

Обучающие данные прошли тщательную обработку. Ключевой момент - обучение с учетом квантования. Система точно моделирует ограничения кода вывода.

Цикл обучения выполняет параллельные проходы. Квантуются и числа с плавающей запятой, и целые. Модель оценивается по тому, насколько хорошо знания сохраняются после квантования.

Веса постепенно смещаются к 2-битной сетке через прямые оценки. Штрафы за переполнение соответствуют ограничениям 16-битного Z80. К концу обучения модель адаптируется к своим ограничениям.

Автор потратил несколько долларов на API Claude. С помощью модели сгенерировал данные для игры в 20 вопросов. Это показывает, как современные AI помогают создавать более простые системы.

Модель обучается на Python. Экспортируется в виде бинарных файлов CP/M .COM. Это формат операционной системы для компьютеров 1970-1980-х годов.

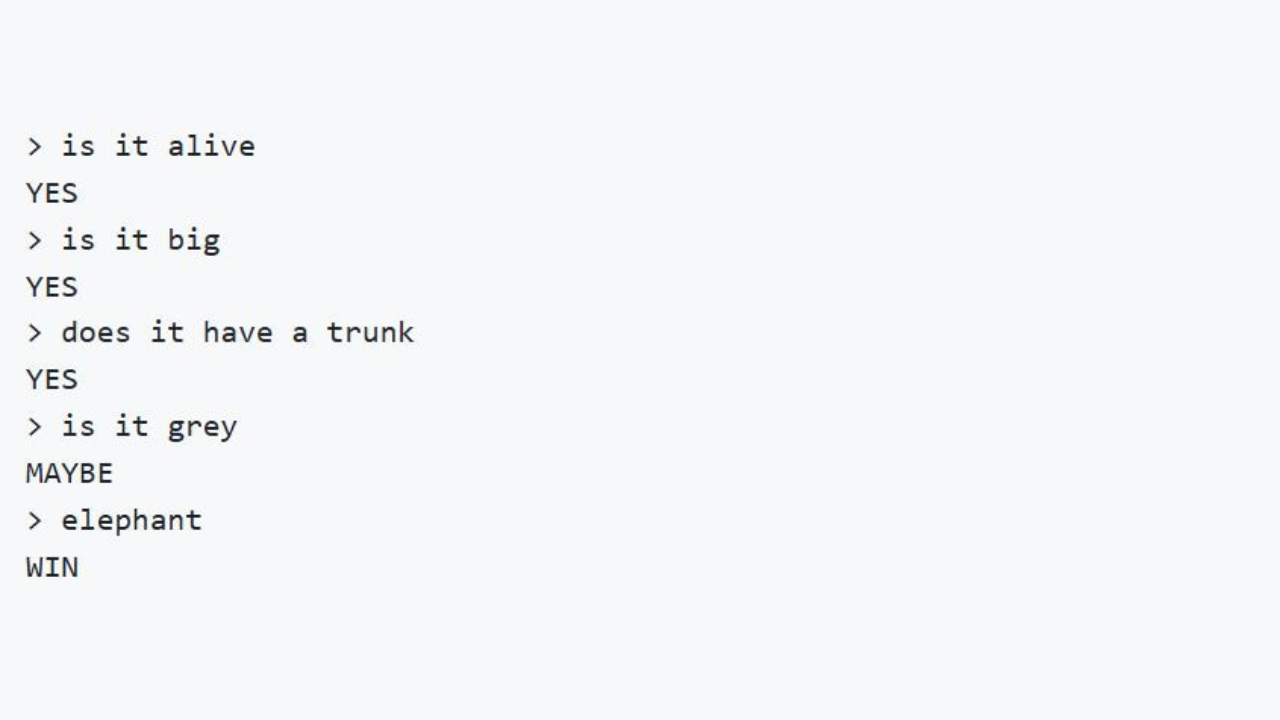

Автор реалистично оценивает возможности проекта. Модель не будет писать электронные письма. Но ее можно обучить играть в упрощенную версию игры 20 вопросов.

Иногда система способна поддерживать иллюзию простых разговоров. Диалоги лаконичные с ярко выраженной индивидуальностью. Это впечатляющий результат для 40 КБ.

Проект показывает границы минимизации AI. Современные языковые модели весят десятки гигабайт. Z80-μLM в миллион раз меньше. Но она все равно демонстрирует элементы интеллектуального поведения.

Это не практический инструмент для реального использования. Проект интересен как техническое достижение и эксперимент по оптимизации.

Z80-μLM доказывает возможность запуска примитивного AI на древнем железе. Процессор Z80 выпустили в 1976 году. Почти 50 лет спустя на нем работает языковая модель.

Проект доступен на GitHub для всех желающих. Энтузиасты могут экспериментировать с кодом и обучать собственные версии модели под разные задачи на ретро-компьютерах.