Команды Together AI и Agentica представили DeepCoder-14B-Preview – открытую модель для программирования, которая достигла впечатляющих результатов уровня проприетарных решений OpenAI.

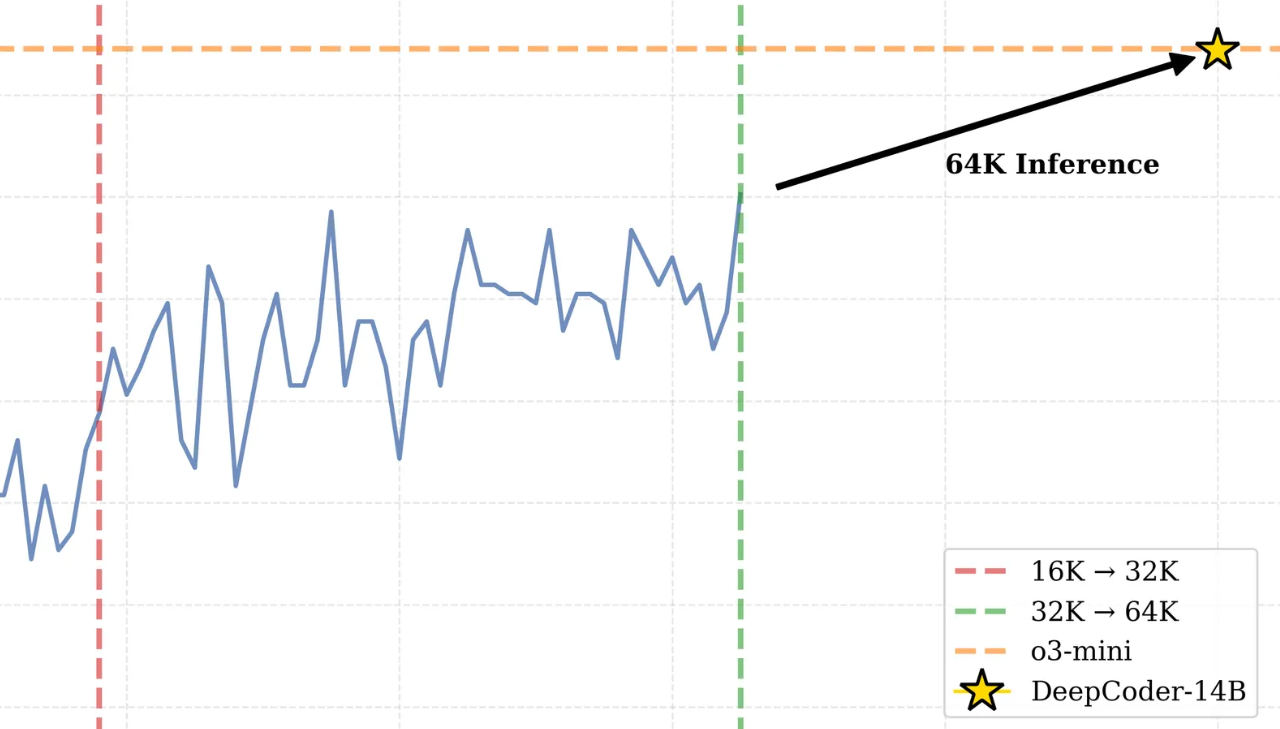

Новая модель продемонстрировала точность в 60.6% на престижном бенчмарке LiveCodeBench, что на 8% превышает предыдущие показатели. На платформе CodeForces модель достигла рейтинга 1936, а на математическом конкурсе AIME 24 показала результат в 73.8%. Эти цифры ставят DeepCoder на один уровень с моделями o3-mini (low) и o1 от OpenAI, при том что новая модель использует всего 14 млрд параметров.

В основе DeepCoder лежит модель R1-Distill-14B, которую команда разработчиков подвергла интенсивному обучению на специально подготовленном датасете из 24 тысяч верифицированных задач по программированию. Процесс обучения занял 2.5 недели на 32 графических процессорах H100, но результат превзошел все ожидания.

Модель, обученная на последовательностях длиной до 32 тысяч токенов, демонстрирует отличные результаты при работе с контекстом до 64 тысяч токенов. Более того, несмотря на специализацию в программировании, DeepCoder показывает высокие результаты и в решении математических задач.

В отличие от закрытых решений крупных корпораций, разработчики DeepCoder полностью открыли исходный код модели, датасет для обучения, логи тренировки и системные оптимизации. Они также представили ‘verl-pipe’ – улучшенную версию системы пост-тренировки verl, которая ускоряет процесс обучения в два раза.